GPT-3 Nedir? Yapay Zeka'nın Geldiği Son Nokta

OpenAI tarafından geliştirilen önceden eğitilmiş yeni dil modeli, yapay zeka camiasını oldukça heyecalandırdı. Kötüye kullanım riski taşıması sebebiyle herkese erişim yetkisi verilmemişti. Ancak bu yetkiye sahip bazı kişiler sosyal medyadan, özellikle de Twitter üzerinden GPT-3 ile neler yapılabildiğini gösteren basit demolar hazırladı. Sonuçlar gerçekten etkileyici ve geleceğe dair umut verici. Peki, bu kadar çok konuşulan GPT-3 aslında nedir?

OpenAI Nedir?

GPT-3 nedir? sorusunu yanıtlamadan önce, bu fikri geliştiren OpenAI şirketini tanıyalım. OpenAI, yapay zekayı (AI) bir bütün olarak insanlığa fayda sağlayacak şekilde geliştirmeyi ve yönlendirmeyi amaçlayan, kar amacı gütmeyen bir araştırma şirketidir. Şirket, 2015 yılında Elon Musk ve Sam Altman tarafından kurulmuştur ve merkezi San Francisco, California’da bulunmaktadır.

Şirketin iki kurucusu ve diğer yatırımcılar, şirketi 1 milyar dolarlık bağışla kurdu. Şubat 2018’de Elon Musk, OpenAI ile Nikola Tesla’dan ilham alan elektronik şirketi Tesla arasındaki çatışma nedeniyle şirketten ayrıldı.

OpenAI şirketinin ilk GPT modeli, Alec Radford, Karthik Narasimhan, Tim Salimans ve Ilya Sutskever tarafından yazılan “Improving Language Understanding by Generative Pre-training (Üretici Ön Eğitimle Dil Anlayışını İyileştirmek) ” başlıklı makalede dile getirildi.

NLP ( Doğal Dil İşleme) Nedir?

Doğal dil işleme, dil bilimi, bilgisayar bilimi gibi bölümleri ele alan multidisipliner bir çalışma alanıdır. Doğal diller ve bilgisayarlar arasındaki bağlantıyı hedefler. Bu bağlantı sayesinde yüksek boyutlu doğal dil verilerinin analiz edilmesi ve modellenmesi oldukça kolay bir hal alır.

Doğal dil işleme alanında her gün birçok araştırma ve geliştirme yapılıyor. Günümüz itibariyle, doğal dil işlemenin kullanıldığı çok sayıda uygulama var. Günlük hayatta en sık karşılaştığımız uygulama Alexa veya Siri’dir. Herhangi bir soru sorulduğunda anlayıp cevaplayabilir, istediğiniz müziği çalabilir. Veri bilimi dünyasında ise NLP metin sınıflandırma, duygu analizi, metin özetleri gibi çeşitli görevlerde kullanılır.

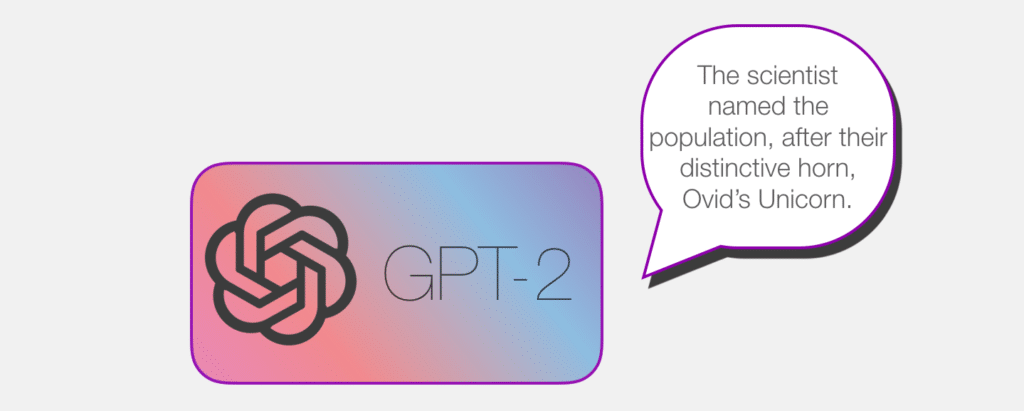

GPT-2 Nedir?

OpenAI, 1.5 milyar parametreli bir dil modeline dayanan dev bir transformatör olan GPT-2’yi piyasaya sürdüğünde uzun bir süre gündemde kalmıştı. GPT-2, 40 GB boyutundaki bir internet metninde bir sonraki kelimeyi tahmin etmek için eğitildi. Kullanılan veri kümesi ise 8 milyon web sayfasından oluşuyordu.

GPT-2, modelin bir girdi ile beslendiği ve büyük bir uzantı oluşturmaya zorlandığı, hiç görülmemiş bir kalitede metin örnekleri üretme gücünü birleştiren çok sayıda yeterliliği yansıtır.

Ek olarak, GPT-2, Wikipedia, haberler veya kitaplar gibi belli başlı alanlarda eğitilmiş çeşitli dil modellerinden daha üstündür. GPT-2, soru yanıtlama, okuduğunu anlama ve açıklama dahil olmak üzere bazı dil görevlerinde, göreve özgü eğitim veri kümelerini uygulamadan bu görevleri ham metinden anlamaya başlar.

Peki, GPT-3 Nedir?

Teknoloji dünyasında sürekli olarak adından söz ettiren OpenAI, geçtiğimiz yıl GPT-2’yi duyurduktan sonra GPT-3 olarak bilinen açık kaynaklı en hızlı NLP framework’ünü ortaya çıkardı.

Makalede yer alan araştırmacılara göre;

“GPT-3, çeviri, soru cevaplama dahil olmak üzere birçok NLP veri kümesinde muazzam bir performans elde etmiştir.”

Ekip ayrıca, “GPT-3’ün, insanların bir makine tarafından yazıldığını bile ayırt etmekte zorluk çekeceği haber makale örnekleri oluşturabileceğini” iddia etti.

GPT-3 Yapısı

- 175 milyar parametreden oluşan son teknoloji bir dil modelidir.

- SuperGLUE benchmarkında önemli sonuçlar elde etti.

- Dil çevirisi, soru cevaplama, şiir oluşturma ve hatta temel matematik gibi NLP görevlerini yerine getirmek için küçük ince ayar gereklidir.

- Üç basamaklı toplama ve çıkarma yapabilir ve İngilizce dil bilgisi konusunda oldukça başarılıdır.

- Yazarların tanımladığı gibi, “meta öğrenmeyi” başarabilir, bu da GPT sinir ağının cümle tamamlama gibi bir görevi gerçekleştirmek için yeniden eğitilme gereksinimi olmadığı anlamına gelir.

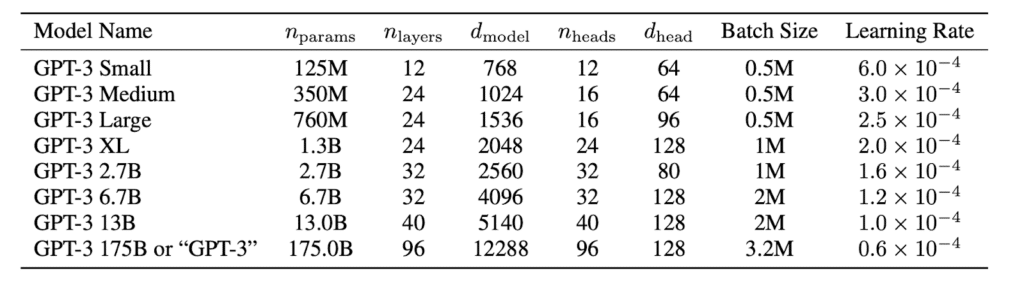

6. Her bir model için parametreler, modelin GPU’lar etrafındaki düzeninde hesaplama verimliliği ve ağırlık stabilizasyonu temelinde oluşturulur.

7. Her model, Microsoft tarafından sağlanan yüksek bant genişliğine sahip bölümünde NVIDIA V100 GPU’lar üzerinde eğitilir.

Kullanılan Yaklaşım

GPT-3 modeli, Common Crawl, Wikipedia, WebText, Books ve bazı ek veri kaynaklarından oluşan bir veri setinin ön eğitimi için Transformer, Attention, vb. konseptler kullanılarak oluşturulmuştur.

Model, çeşitli NLP benchmarklarına göre değerlendirildi ve soru cevaplama görevlerinde müthiş bir performans elde edildi.

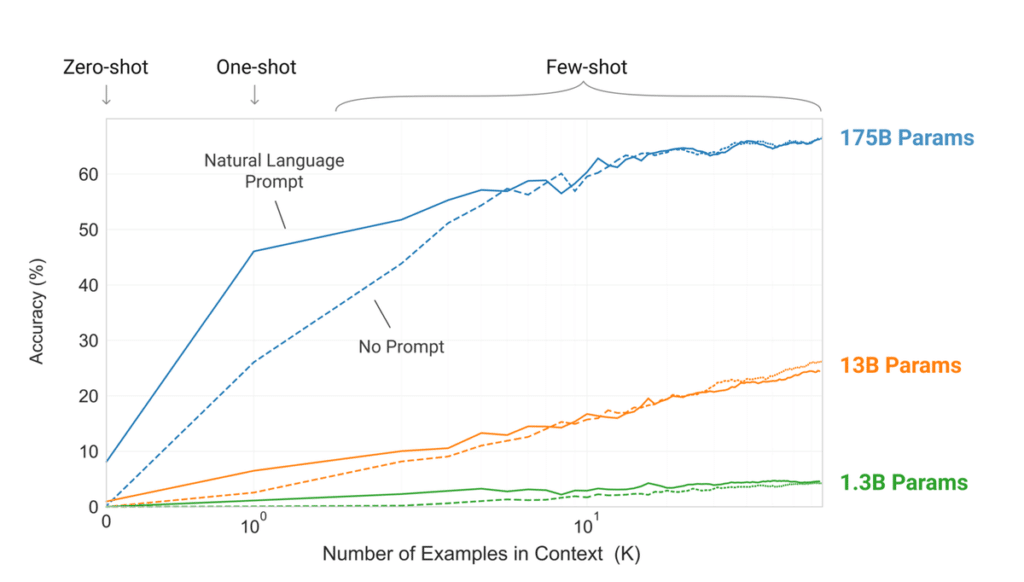

Araştırmacılar, modelin verimliliğini GPT-3 ile karşılaştırmak için 125 milyon parametreden 13 milyar parametreye kadar değişen 3 adet küçük model eğitti.

Yukarıdaki grafikte, model parametrelerinin sayısına göre elde edilen doğruluk oranı gösterilmiştir. Bu grafikten yola çıkarak, model parametresi miktarının arttırılması doğruluk oranını da gözle görülür derecede arttığı görülmektedir.

GPT-3 Kullanım Alanları

1. E-Tablolar Üzerinde Otomatik Tamamlama

Paul Katsen isimli kişinin geliştirmiş olduğu GPT-3 modeli, Excel üzerinden otomatik tamamlama yapabiliyor. Herhangi bir formül belirtilmeden iki kolon arasındaki bağlantıyı anlayıp yazılan eyaletin popülasyonunu hesaplayabilirken aynı şekilde matematik işlemlerini de yapabiliyor.

2. İngilizceden SQL’e çeviri

Faraaz Nishtar isimli kişinin oluşturmuş olduğu GPT-3 modeli, girdi olarak ingilizce bir metin alıp bunu SQL sorgusu haline getiriyor. Şimdilik başlangıç seviyesinde çalışsa da ilerisi için çok şey vaat ediyor. Daha kompleks metinleri SQL sorgusuna dönüştürdüğü zaman, birçok kişinin iş yükünü hafifletecektir.

3. Basit İngilizce ile Kullanıcı Arayüzü Tasarımı

Dhvanil isimli kullanıcı ise, GPT-3’ü kullanarak Figma üzerinden bir kullanıcı arayüzü tasarladı. Bu kullanıcı arayüzü basit bir ingilizce ile oluşturulabiliyor. GPT-3 nedir sorunu ve bu modelin nasıl çalıştığının detayını ise Twitter üzerinden açıkladı.

4. Metinden CSS Koduna Çeviri

Zoli Szőgyényi adlı kişinin tasarlamış olduğu GPT-3 modeli, girdi olarak ingilizce bir metin alıyor ve bunu CSS koduna dönüştürüyor. Şuan için basit metinleri dönüştürebilse de ilerisi için umut verici. İleride web geliştiricilerin işini elinden alabilecek gibi gözüküyor.

5. Arama Motoru

Paras Chopra adlı kullanıcı ise GPT-3 kullanarak tam işlevli bir arama motoru yaptı. Herhangi bir sorgu için, tam yanıtı ve karşılık gelen URL’yi döndürüyor.